Cualquier animal puede superar sin problemas los logros obtenidos por la tecnología actual a la hora de identificar o reaccionar ante la presencia de objetos. Esto es particularmente notorio en ambientes complejos, o en entornos en los que la intensidad de la luz cambia rápidamente. Pero un nuevo sistema de visión robótica puesto a punto por el Instituto de Neuroinformática de la Universidad de Zurich que funciona como una retina de silicio analógica, ayudado por un par de motores, ha logrado mantener en equilibrio un lápiz sobre su afilada punta. Se trata del Pencil Balancer, un logro impresionante que debes ver. A pesar de la muy buena calidad que poseen nuestras cámaras de vídeo y la potencia de cálculo que han demostrado los microprocesadores disponibles en el mercado, la visión artificial -una rama de la inteligencia artificial que utiliza estos dos elementos- no termina de despegar.

Una de las causas que se pueden mencionar como responsables de esta situación es que la mera “fuerza bruta” proporcionada por el hardware no basta para poner a punto un buen sistema de visión artificial. Hace falta también un software adecuado, que sea capaz de procesar los datos proporcionados por las cámaras de vídeo e inferir que es lo que se encuentra delante de estas. Se trata de un enorme desafío, ya que extraer la información importante de una secuencia de imágenes proporcionadas por una cámara y convertirla en datos útiles requiere de una gran dosis de “inteligencia”. Uno de los obstáculos a superar es que la mayor parte de la información contenida en un vídeo es redundante, y no puede ser descartada antes de ser analizada, factor que limita mucho la velocidad final de un sistema de visión artificial.

No poder descartar los cuadros de vídeo superfluos es uno de los más importantes escollos que limitan la velocidad con la que un robot puede reaccionar frente a un estimulo visual. Mantener en equilibrio objetos de gran tamaño es uno de los ejercicios que los investigadores del campo de la robótica mejor conocen. Incluso los aficionados suelen construir sistemas que mantienen en equilibrio un objeto masivo o hasta una persona, más o menos como lo hace un Segway. Pero equilibrar un objeto con poca masa -y por ende, con una mayor tendencia a acelerarse en una u otra dirección- es una cuestión completamente diferente. Este es el motivo por el que casi cualquier persona puede mantener una escoba en equilibrio sobre un dedo, pero prácticamente nadie lo puede hacer con una cerilla.

En el Instituto de Neuroinformática de la Universidad de Zurich, un grupo de expertos desarrolló una retina de silicio analógico que, a diferencia de las cámaras de vídeo normales, sólo informa de los eventos individuales (o “picos“) que detecta en cada uno de los píxeles individuales que componen la imagen. Los cambios en el nivel de iluminación que reciba cada píxel del sensor de la cámara solo genera una señal de “on” u “off”, lo que reduce drásticamente la cantidad de datos que se necesitan procesar por el “cerebro” del sistema cada vez que tiene lugar un cambio de este tipo. Esta manera de trabajar se ha inspirado directamente en la forma que tiene lugar el intercambio de información entre el ojo humano y la corteza visual, zona del cerebro encargada de procesar lo que vemos.

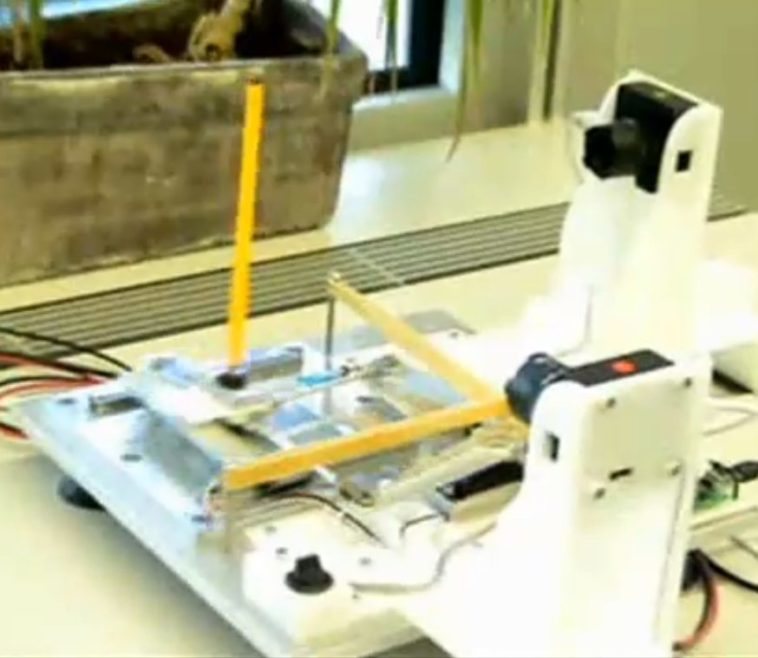

Los expertos utilizaron esta “retina artificial” para construir un “robot” -el Pencil Balancer– que es capaz de mantener un lápiz cualquiera en equilibrio sobre su afilada punta, a partir únicamente de la información recogida por las cámaras. Un par de “retinas de silicio”, ubicadas en forma perpendicular una de la otra, se encargan de recoger los eventos que genera el lápiz en movimiento. Envían esa información al microprocesador que tiene a cargo el control de los motores, y este mueve la base que sostiene el lápiz en la dirección correcta para evitar su caída. El vídeo, como habrás visto, es impresionante. A diferencia de otros sistemas similares, se ha utilizado un algoritmo que solo procesa los cambios de luz producidos por los movimientos del lápiz, sin utilizar toda la información que normalmente proporciona una cámara (color, movimiento, etcétera).

“Nuestro sistema”, explican en el Instituto de Neuroinformática, “se ha inspirado en la forma en que la naturaleza ha resuelto el problema de la visión.” Como hemos visto en otras oportunidades, los millones de años de evolución han proporcionado a los seres vivos de la Tierra una serie de soluciones que podemos imitar para dotar a nuestros robots de “sentidos” mucho más eficaces que los disponibles en la actualidad. Y esto es exactamente lo que han hecho en la Universidad de Zurich. ¿Interesante, verdad?