En las últimas semanas, los usuarios han generado millones de imágenes con inteligencia artificial. Escenarios fantásticos, combinaciones absurdas, aciertos extraordinarios y errores espantosos son una parte esencial de estos modelos que siguen avanzando, pero la gente de NVIDIA Research ya trabaja en lo que podríamos considerar como su salto evolutivo: GET3D, un sistema generativo para objetos tridimensionales con texturas, partiendo de un dataset basado en imágenes 2D.

«Landscape of an old forest, autumn season, brown and golden leaves, sunbeams passing through the trees, old worn out road, oil painting over canvas, highly detailed»

«Paisaje de un antiguo bosque, temporada de otoño, hojas marrones y doradas, rayos de sol pasando entre los árboles, camino viejo y gastado, óleo sobre lienzo, alto detalle». Después de unos diez minutos y varias revisiones, Stable Diffusion presentó esto:

Y ni siquiera se está esforzando, porque utilicé un prompt bastante genérico. Si hubiera inyectado un estilo más específico o el nombre de algún artista, el resultado sería aún mejor. Esto es apenas una muestra de lo que puede hacer la generación de imágenes con inteligencia artificial hoy. Todavía tiene mucho trabajo por delante, especialmente en lo que se refiere a anatomía humana (manos con siete dedos, tres brazos, etc.), pero el tiempo y la tecnología están a su favor.

De hecho, ya hemos hablado sobre la generación de vídeo usando texto, y ahora llega el turno de NVIDIA con su proyecto GET3D, que apunta a la construcción de objetos y personajes tridimensionales:

NVIDIA GET3D: De 2D a 3D, con inteligencia artificial

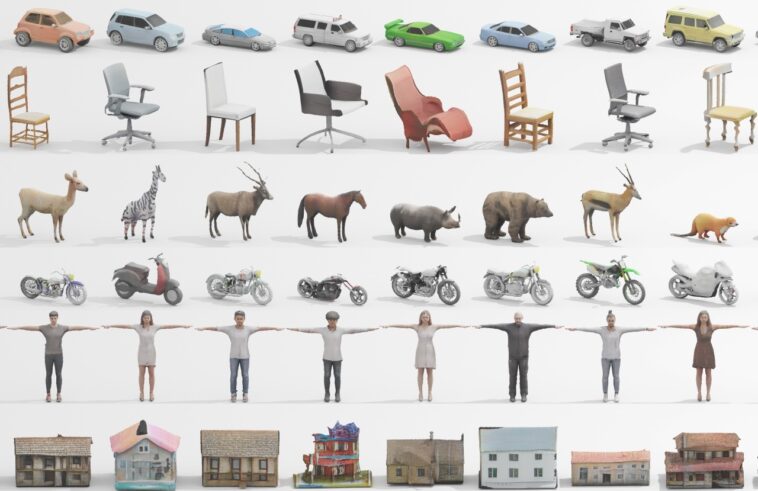

Uno de los aspectos más interesantes de GET3D es que su entrenamiento se basa en un dataset con imágenes en dos dimensiones. Todos los modelos generados adoptan un formato popular que les permite ser importados con facilidad en las principales aplicaciones de edición, ya sea para un renderizado posterior, o su inserción en motores gráficos. Por supuesto, todo algoritmo es tan bueno como el entrenamiento que recibe, y GET3D no es la excepción. La breve demo de Nvidia se enfoca en coches (desde camionetas hasta vehículos de carrera), motocicletas, sillas, personas y animales.

Una de las prioridades para GET3D es el detalle. Todos los modelos generativos previos sufren limitaciones importantes en este punto, pero GET3D apuesta a un mayor tamaño y diversidad en los datasets, al mismo tiempo que optimiza la cantidad: Nvidia anticipa que usando un solo GPU (imagino algo como un A100), GET3D puede generar 20 objetos por segundo, y su entrenamiento con un millón de imágenes tomó dos días (una vez más, con GPUs A100).

¿La mejor parte? GET3D es open source. Nvidia ya creó un perfil en GitHub, y compartirá más información en los próximos días.

Anuncio oficial: Haz clic aquí