Así como los pintores más famosos se hacían docenas a lo largo de sus carreras desde hace siglos, los humanos de esta era nos hacemos hasta mil autorretratos en un mes. A esto lo ha potenciado la masividad de las cámaras digitales y la presencia de internet como galería gratuita y abierta a todo público. Con esto en vista, los métodos para sacarse fotos a sí mismo han ido avanzando hasta llegar a pantallas frontales, reconocimiento de rostro y de sonrisas como mecanismos de activación. Pero ahora unos investigadores japoneses planean dar el próximo salto: autorretratos más precisos utilizando realidad aumentada y reconocimiento de gestos manuales a distancia.

A pesar de que es lo primero que desactivo cuando manipulo una cámara digital moderna, la detección de gestos faciales, movimientos, sonrisas y todo tipo de automatizaciones que se encuentran a un botón de distancia, hay que reconocer que son ventajas aplaudidas y celebradas por gran parte de los usuarios. Sobre todo en una era donde el auto retrato ha tomado por asalto la red y ha hegemonizado todo tipo de álbum con el que nos podamos encontrar. Estos métodos no son del todo precisos y eficientes, y al final se termina perdiendo momentos de naturalidad porque la cámara “sacó la foto cuando quiso”. Antes esto las pantallas frontales en las cámaras han surgido como una respuesta a este tipo de problemas, pero siempre se puede hacer más. Como por ejemplo, controlar ajustes y tomar fotografías con tus manos… pero sin tocar la cámara.

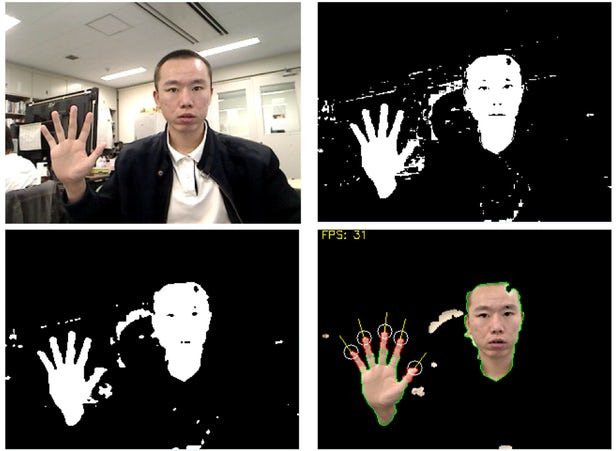

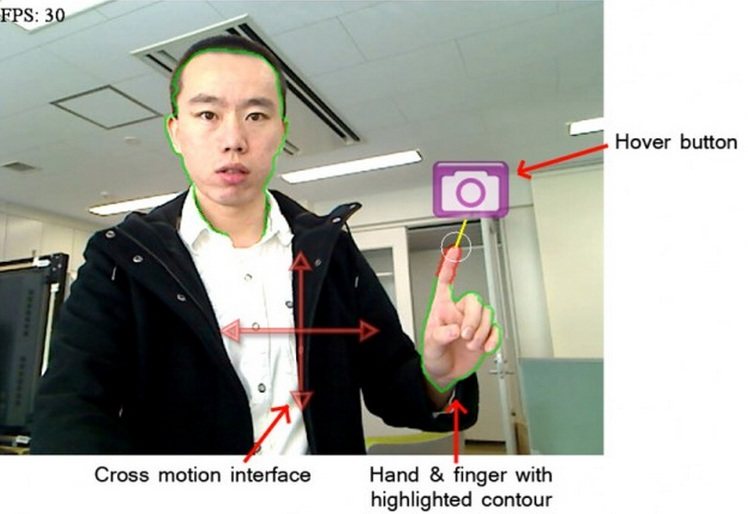

El avance viene desde Japón, ya que investigadores de la Universidad de Tsukuba están desarrollando una tecnología que permitirá rastrear movimientos del objetivo a fotografiar y usarlos como disparadores automáticos más precisos, tanto del obturador como de opciones de enfoque y lo único que necesita es tener una cámara con un visor frontal, que ya son una constante en cualquier vidriera de tienda de electrodomésticos. Aunque también son óptimos los que pueden rotarse. La ciencia en este nuevo sistema en desarrollo es que se utiliza un algoritmo mejorado de visión propio de los investigadores nipones, que puede leer, como si fuera Kinect, los bordes de tu mano y tu rostro, para que puedas, con cada dedo, modificar diferentes tipos de ajustes, filtros y cualquiera sea el parámetro al que asocies tus dedos, que se verán en la pantalla frontal como si fuera realidad aumentada.

Creado por Shaowei Chu y Jiro Tanaka, el algoritmo detecta el contorno de tus manos y dedos con una doble lectura, por lo que puedes, al mismo tiempo, rotar la cámara mientras accionas. Por ejemplo, cuando realizas una grabación y haces un zoom a la vez, a lo que también lo podrás sumar un paneo, lo que hace que los autorretratos o los vídeos accedan a una etapa más de avance. Para activar este sistema y realizar una fotografía, por ejemplo, el usuario necesitará mantener un dedo en alto apuntando hacia arriba durante algunos segundos, ubicándolo de manera que quede a la derecha de la cámara; el obturador se disparará. Esto, creemos, debería ser absolutamente configurable, con lo que cada usuario podría decidir con qué gesto realizar la toma. Como hemos dicho, todavía está en desarrollo y el dispositivo, que todavía no se ha mostrado concretamente, necesita ser compactado y optimizado como para verlo en el circuito comercial prontamente. En cuanto sepamos algo más, serás el primero en saberlo.

Ja ja ja. El de la foto se parece a Cho Seung-hui (http://www.dogguie.com/wp-content/uploads/2008/02/th-cho.jpg).

#1 ja, es cierto